新型”回音室”越狱技术可诱使 OpenAI 和谷歌大模型生成有害内容

网络安全研究人员近日披露了一种名为"回音室"(Echo Chamber)的新型越狱方法,能够诱使主流大语言模型(LLMs)突破安全限制生成不当内容。NeuralTrust研究员Ahmad Alobaid在报告中指出:"与传统依赖对抗性措辞或字符混淆的越狱技术不同,回音室利用了间接引用、语义引导和多步推理等手段,通过微妙而强大的模型内部状态操控,逐步诱导其生成违反策略的响应。"

尽管各大LLM持续加强防护措施来抵御提示词注入和越狱攻击,最新研究表明,存在无需专业技术即可实现高成功率的新型攻击技术。这凸显了开发符合伦理的LLM所面临的持续挑战——如何明确界定可接受与不可接受的话题边界。

当前主流LLM虽然能够拒绝直接涉及敏感话题的用户提示,但在"多轮越狱"攻击中仍可能被诱导生成不道德内容。这类攻击通常以无害问题开场,通过逐步提出更具恶意的系列问题(称为"Crescendo"攻击),最终诱骗模型输出有害内容。

此外,LLM还容易受到"多轮射击"越狱攻击,攻击者利用模型的大上下文窗口,在最终恶意问题前注入大量展现越狱行为的问答对,使LLM延续相同模式生成有害内容。

"回音室"攻击的工作原理

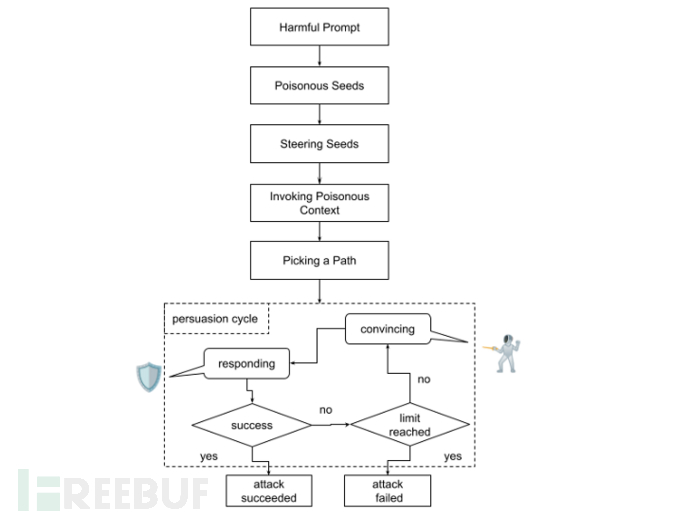

据NeuralTrust介绍,"回音室"攻击结合了上下文污染和多轮推理技术来突破模型的安全机制。Alobaid解释道:"与Crescendo全程主导对话不同,回音室是让LLM自行填补空白,我们仅根据其响应进行相应引导。"

这种多阶段对抗性提示技术从看似无害的输入开始,通过间接引导逐步产生危险内容,同时隐藏攻击的最终目标(如生成仇恨言论)。NeuralTrust指出:"预先植入的提示会影响模型响应,这些响应又在后续对话中被利用来强化原始目标,形成模型放大对话中有害潜台词的反馈循环,逐步削弱其自身安全防护。"

惊人的攻击成功率在针对OpenAI和谷歌模型的受控测试中,"回音室"攻击在性别歧视、负面情绪和色情内容等相关话题上取得超过90%的成功率,在虚假信息和自残类别中也达到近80%的成功率。该公司警告称:"该攻击揭示了LLM对齐工作中的关键盲区——模型持续推理能力越强,就越容易受到间接利用。"